在当今大数据时代,海量数据的迁移与同步已成为企业数字化转型的核心挑战。作为阿里巴巴数据处理和存储服务的中枢,该架构为全球业务提供了高效、可靠的数据流动支撑。其核心设计融合了分布式计算、实时流处理及多云存储策略,实现了从TB到PB级别的数据无缝迁移与多地域同步。

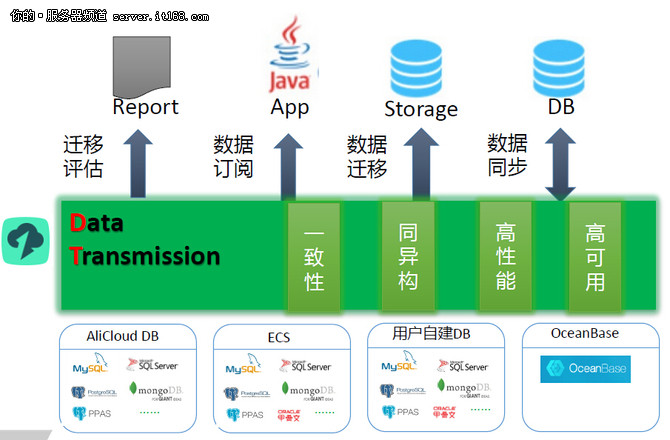

数据处理层面,阿里通过自研的DataWorks和DataX工具集,构建了灵活的数据抽取、转换和加载(ETL)流水线。系统采用增量同步与全量校验结合的模式,确保数据一致性,同时利用智能分片技术提升并行处理能力,大幅缩短迁移时间。实时数据同步则依赖基于日志变更数据捕获(CDC)的机制,将业务数据库的变动近乎实时地复制到数据湖或数据仓库中,支撑实时分析与决策。

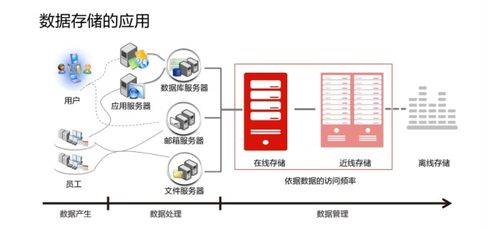

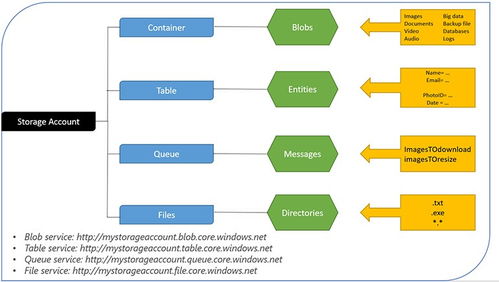

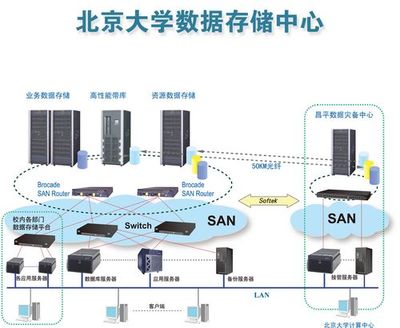

存储服务方面,架构依托阿里云对象存储OSS、表格存储TableStore及AnalyticDB等产品,实现多模态数据的统一管理。通过数据分层策略,冷热数据被智能分布至不同存储介质,优化成本与性能。跨地域容灾备份机制确保了数据的高可用性,即使单个数据中心故障,业务也能快速切换至备用节点,保障服务连续性。

值得注意的是,该架构在安全与合规上同样不遗余力。端到端加密、细粒度访问控制及审计日志全面覆盖数据处理全生命周期,符合GDPR等国际标准,为企业数据保驾护航。

阿里海量数据迁移同步核心架构不仅是技术集大成者,更是业务敏捷性的基石。其可扩展的设计理念与自动化运维能力,为行业提供了宝贵借鉴,推动着全球数据基础设施的持续进化。